在“壯闊東方潮 奮進新時代”的宏大敘事中,貴州省以其前瞻性的戰略眼光和果敢的實踐,書寫了大數據發展的精彩篇章。曾經被束之高閣、深藏于各部門“閨中”的政務數據,正以前所未有的開放姿態,匯入時代發展的洪流,成為驅動創新、賦能發展的核心要素。貴州,正以其鮮明的開放共享姿態,有力地拍打著全球大數據產業的浪潮,并積極探索數據交易服務的新模式與新路徑。

一、破局:從“數據孤島”到“數據江河”

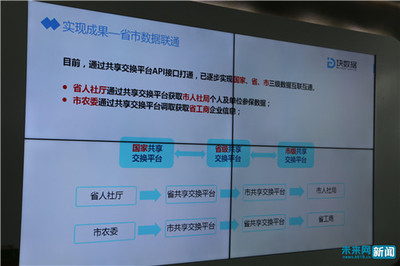

長期以來,政務數據因其敏感性、部門分割等原因,形成了諸多“數據孤島”,價值難以釋放。貴州率先破局,以“云上貴州”系統平臺建設為抓手,大力推進政務數據“聚、通、用”。通過制度創新與技術創新雙輪驅動,打破部門壁壘和系統阻隔,將分散的數據資源進行匯聚、整合與治理。這不僅是物理上的集中,更是邏輯上的聯通與業務上的協同,讓原本靜默的數據開始流動、碰撞與融合,如同涓涓細流匯成奔涌的江河,為深度挖掘與應用奠定了堅實基礎。

二、賦能:開放共享激發無限潛能

數據只有流動起來,才能創造價值。貴州深諳此道,積極探索政務數據資源面向社會有序開放。通過建設全省統一的政府數據開放平臺,依法依規向社會公眾、企事業單位和科研機構提供涵蓋經濟發展、民生服務、生態環境等眾多領域的可機讀數據集。這種開放共享,絕非簡單的數據公開,而是旨在降低社會獲取數據的門檻,激發市場和社會主體的創新活力。企業可以利用開放數據優化產品與服務,科研機構可以藉此開展前沿研究,公眾可以更便捷地獲取信息、參與社會治理。政務數據從管理資產轉變為創新生產要素,賦能千行百業數字化轉型和高質量發展。

三、探路:數據交易服務的“貴州實踐”

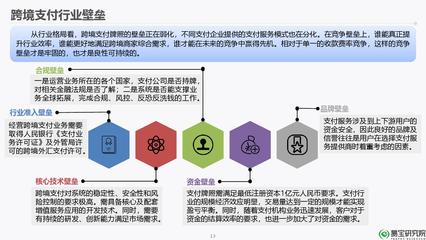

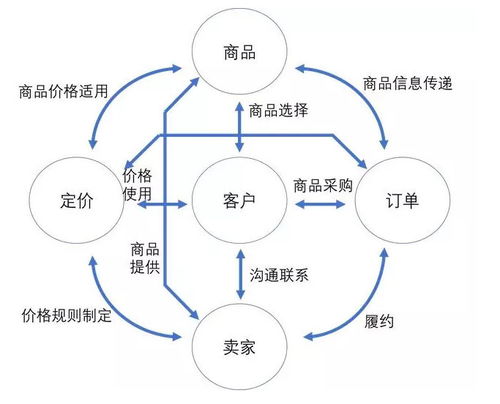

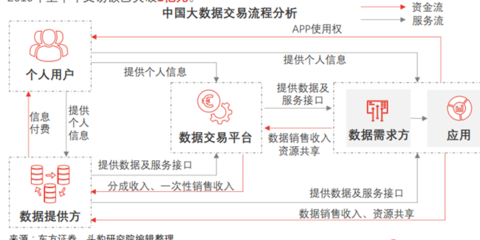

在推動數據資源化、資產化的進程中,貴州再次走在前列,積極探索建立合規、安全、高效的數據要素市場。貴陽大數據交易所的創新發展,便是其中的關鍵一環。貴州著力完善數據確權、定價、交易、安全等基礎制度和標準規范,嘗試構建覆蓋數據登記、評估、交易、結算全過程的服務體系。其目標不僅是促進數據作為商品進行流通交易,更深層次的是要探索建立一套適應數字經濟發展規律、保障各方權益的數據要素市場化配置機制。盡管數據交易在全球范圍內仍面臨諸多挑戰,但貴州的“先行先試”為國家層面完善數據基礎制度、培育數據市場提供了寶貴的“地方經驗”和“實踐參考”。

四、引領:姿態決定浪潮之巔的思考

貴州以“開放共享”的堅定姿態拍打大數據浪潮,其意義遠超技術或產業層面。它體現的是一種順應數字化時代發展規律的前瞻思維,一種打破常規、勇于創新的改革勇氣,一種追求高質量發展的務實行動。政務數據的開放共享與交易探索,不僅提升了政府治理能力和公共服務水平,優化了營商環境,更關鍵的是,它正在塑造一個基于數據驅動的新經濟生態,為后發地區實現跨越式發展提供了可資借鑒的范式。

站在新時代的潮頭,貴州的故事昭示:數據,唯有在安全可控的前提下開放、流動、共享、交易,其巨大潛能才能噴薄而出。從深藏“閨中”到匯入“江河”,再到探索市場化“航道”,貴州的實踐是中國大數據產業奮進的縮影,也必將為“數字中國”建設注入更加強勁的“貴州動能”。未來的浪潮將更加壯闊,而開放共享,始終是搏擊浪濤、駛向未來的正確姿態。